Dans le paysage numérique actuel, une transcription audio précise est essentielle pour les créateurs de contenu, les enseignants et les entreprises. La bonne nouvelle est que plusieurs fournisseurs de cloud proposent des niveaux gratuits de services de synthèse vocale, permettant aux développeurs de créer des prototypes et de tester sans frais initiaux.

Partie 1 :API Speech-to-Text gratuites que vous pouvez essayer dès aujourd'hui

Ci-dessous, nous comparons les principales offres gratuites, résumant leurs points forts, leurs limites et leurs cas d'utilisation idéaux. Le niveau gratuit de chaque fournisseur est suffisamment généreux pour les petits projets et les expérimentations rapides.

-

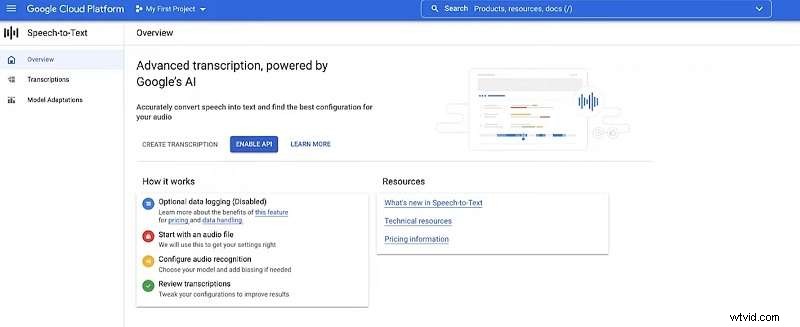

API Speech-to-Text de Google Cloud

- 60 minutes de transcription gratuite par mois ; les nouveaux utilisateurs reçoivent 300 $ de crédits pendant 12 mois.

- Prend en charge 125 langues et dialectes, avec des modèles spécialisés pour la commande vocale, les appels téléphoniques et la vidéo.

- L'adaptation avancée du modèle améliore la précision des vocabulaires personnalisés et des sons bruyants.

- L'offre gratuite vous limite à 60 minutes ; les projets plus importants nécessitent des forfaits payants.

- Nécessite l'importation de données audio dans un bucket Google Cloud Storage.

Idéal pour les indépendants et les petites entreprises ayant besoin de transcriptions occasionnelles de haute qualité.

-

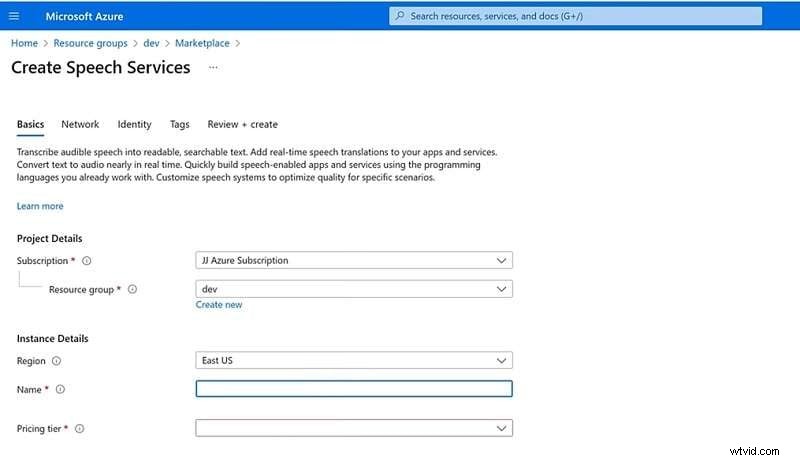

Service vocal Microsoft Azure

- L'offre gratuite comprend cinq heures d'audio et un modèle vocal personnalisé par mois.

- Transcription en temps réel et traitement par lots des fichiers stockés dans Azure Blob Storage.

- Prend en charge les vocabulaires personnalisés et les conteneurs sur site.

- La configuration est plus complexe ; le quota gratuit peut ne pas suffire pour de lourdes charges de travail.

Idéal pour les organisations qui utilisent déjà Azure et qui ont besoin d'une terminologie spécifique à leur secteur.

-

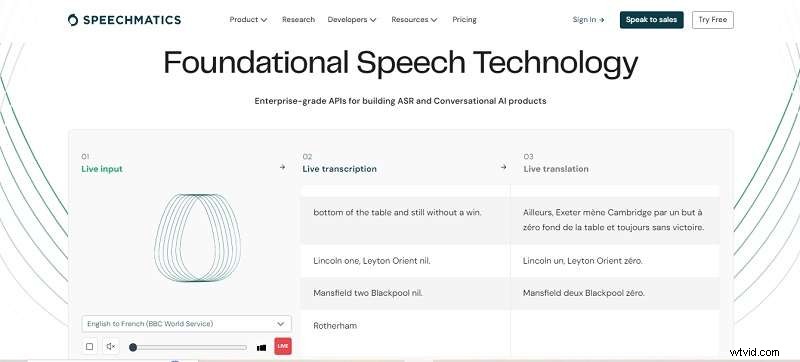

Orthophonie

- 8 heures de transcription gratuite par mois (4 heures par lots, 4 heures en temps réel).

- Prend en charge plus de 50 langues et offre une latence inférieure à la seconde pour une utilisation en temps réel.

- Détection automatique de la langue, horodatage par mot et exportation SRT.

- Nécessite une configuration technique et est destiné à une utilisation en entreprise.

Excellent pour les pipelines de transcription multimédia ou de service client à grande échelle.

-

AssemblyAI

- Les nouveaux utilisateurs reçoivent un crédit de 50 $ ; propose deux modes de transcription : « Meilleur » (haute précision) et « Nano » (rentable).

- Comprend la hiérarchisation des intervenants, la détection des sujets, l'analyse des sentiments et l'autocensure.

- Couverture linguistique limitée et erreurs occasionnelles liées au bruit.

Idéal pour les réunions, les interviews et les podcasts avec plusieurs intervenants.

-

AWS Transcribe

- Niveau gratuit : 1 heure de transcription par mois pendant la première année.

- Prend en charge la ponctuation, les vocabulaires personnalisés, l'identification de plusieurs locuteurs et la diffusion en direct.

- Nécessite que l'audio réside dans Amazon S3.

Convient aux entreprises qui utilisent déjà AWS pour d'autres services.

Partie 2 :Premiers pas avec une API Speech-to-Text

La plupart des fournisseurs proposent une documentation complète et des bibliothèques client dans des langues populaires. Vous trouverez ci-dessous un guide étape par étape pour Google Cloud, qui est représentatif du processus pour d'autres services.

- Créez un projet Google Cloud et activez l'API Speech-to-Text.

- Générez une clé de compte de service (JSON) pour l'authentification.

- Installer la bibliothèque client :

pip install google-cloud-speechpour Python. - Écrivez un script qui télécharge le fichier audio (ou le diffuse en continu) et appelle

recognize()oulong_running_recognize(). - Gérez la réponse :extrayez les transcriptions, les horodatages et exportez-les si nécessaire.

Pour visionner une présentation vidéo complète, consultez le guide de démarrage rapide de Google . .

Partie 3. Transcription non technique avec Filmora

Si le codage n'est pas votre point fort, Wondershare Filmora propose une fonction parole-texte intégrée qui génère automatiquement des sous-titres et des transcriptions. Il prend en charge l'anglais, le français, l'espagnol, l'indonésien, l'hindi, le japonais et plus encore.

Quand utiliser Filmora au lieu d'une API

- Utilisateurs non techniques qui préfèrent un flux de travail par glisser-déposer.

- Projets à réalisation rapide, tels que de courtes vidéos ou des clips pour les réseaux sociaux.

- Montage vidéo intégré où les sous-titres peuvent être ajoutés directement à la timeline.

Étape par étape :Transcription dans Filmora

- Ouvrez Filmora, créez un nouveau projet et importez votre fichier audio ou vidéo.

- Faites glisser le fichier sur la timeline, sélectionnez-le et accédez à

Tools > Audio > Speech to Text. - Choisissez la langue source, définissez « Aucune traduction » si vous le souhaitez et spécifiez le format de sortie (SRT).

- Cliquez sur

Generateet attendez que la transcription soit terminée. - Double-cliquez sur la piste de texte générée pour modifier et corriger toute inexactitude.

- Exportez le fichier SRT final ou intégrez les sous-titres directement dans la vidéo.

Conclusion

Les API gratuites de synthèse vocale offrent un moyen rentable d'intégrer la transcription dans vos applications. Google Cloud, Azure, Speechmatics, AssemblyAI et AWS Transcribe offrent chacun des atouts distincts, alors choisissez en fonction de la prise en charge linguistique, des vocabulaires personnalisés et des écosystèmes cloud existants. Pour les utilisateurs non techniques ou les projets vidéo rapides, la fonctionnalité intégrée de Filmora offre une alternative sans tracas.